Apple Intelligence : pourquoi l’outil d’IA de résumés d’actualité a été temporairement désactivé

L’outil étonnant d’Apple, Apple Intelligence, censé résumer l’actualité de manière automatisée, a été temporairement retiré de la version bêta d’iOS. Cette décision intervient après la diffusion d’erreurs majeures dans les notifications qu’il produisait, notamment des informations incorrectes attribuées à des sources fiables comme la BBC. Dans cet article, nous analysons les raisons de ce retrait, les critiques reçues par cet outil, et les perspectives pour son évolution future.

Une IA prometteuse, mais imparfaite

L’objectif d’Apple Intelligence

Apple Intelligence avait pour ambition de transformer la manière dont les utilisateurs d’iPhone accédaient à l’actualité. Ce système basé sur l’intelligence artificielle générait des résumés d’actualité présentés sous forme de notifications rapides et concises. L’idée était de fournir une expérience utilisateur optimisée, permettant de rester informé sans passer par des articles complets.

Cependant, malgré ses promesses, cette fonctionnalité a rapidement montré des limites majeures. En janvier, Apple avait promis de corriger les erreurs rencontrées, mais le 16 janvier, l’entreprise a annoncé, via l’Agence France-Presse, le retrait temporaire de cette fonctionnalité dans la version expérimentale d’iOS Beta 18.3.

Les erreurs marquantes

Parmi les incidents signalés, Apple Intelligence a relayé des informations incorrectes qui ont suscité de vives critiques. Voici quelques exemples de ces échecs :

- L’annonce prématurée du vainqueur du championnat mondial de fléchettes alors que la compétition n’était pas terminée.

- Une affirmation erronée selon laquelle le tennisman Rafael Nadal aurait annoncé son homosexualité.

- Une fausse information concernant le suicide de Luigi Mangione, présenté à tort comme coupable de meurtre.

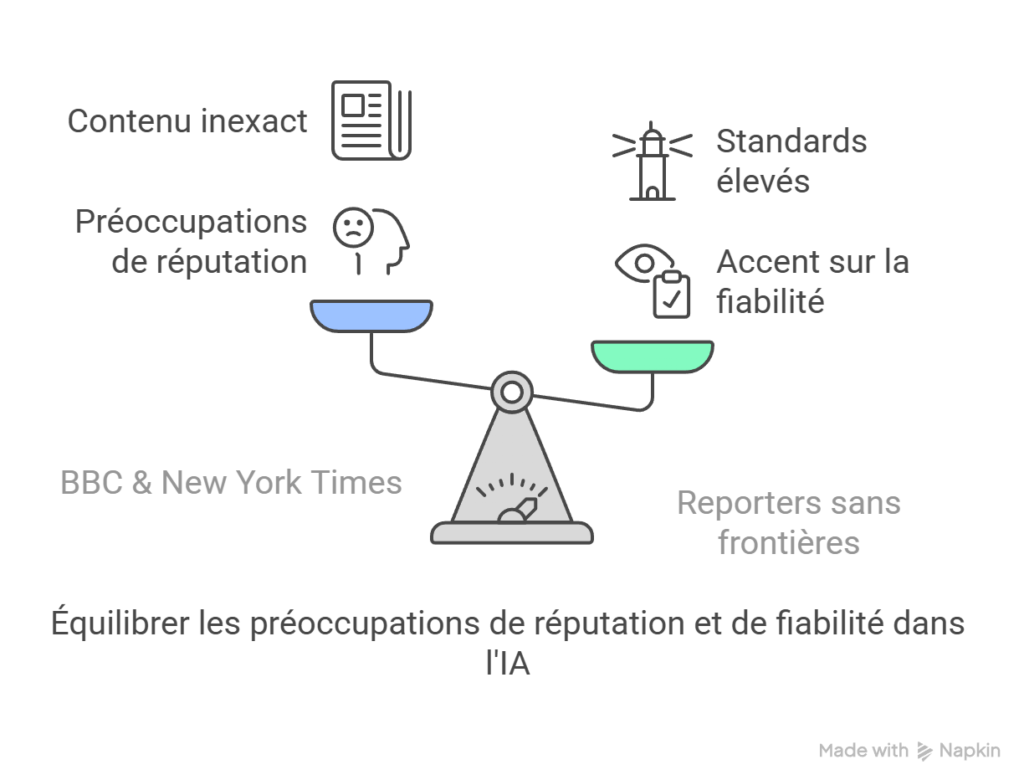

Ces erreurs ont été attribuées à des sources reconnues, telles que la BBC et le New York Times, ce qui a entaché leur crédibilité. Ces incidents ont mis en lumière les risques liés à l’utilisation d’outils basés sur l’IA générative dans le domaine de l’information.

Les réactions face à ce retrait

Les critiques des médias et des organisations

La BBC et le New York Times ont vivement critiqué Apple Intelligence pour avoir utilisé leur nom de manière abusive. Les résumés d’actualité, présentés comme provenant directement de ces sources, ne reflétaient pas leur contenu réel, ce qui a provoqué des préoccupations sur la préservation de leur réputation.

De son côté, Reporters sans frontières a demandé le retrait définitif de cette fonctionnalité. Dans un communiqué publié en décembre, l’ONG a déclaré que « les services à base d’IA générative sont encore trop immatures pour produire de l’information fiable ». Elle a ajouté que ces outils ne devraient pas être autorisés à opérer sur le marché tant qu’ils ne respectent pas des standards élevés de fiabilité et de précision.

La réaction d’Apple

Malgré les critiques, Apple prévoit de réintroduire Apple Intelligence une fois que des améliorations significatives auront été apportées. La marque à la pomme s’est engagée à clarifier la provenance des résumés d’actualité afin d’éviter toute confusion avec des sources journalistiques réputées.

Dans un premier temps, ces synthèses porteront une mention explicite indiquant qu’elles sont générées par Apple Intelligence, ce qui devrait limiter les malentendus.

Les défis de l’IA dans le journalisme

Une technologie encore immature

Les incidents liés à Apple Intelligence illustrent un problème plus large concernant les systèmes d’IA générative. Ces outils, bien qu’innovants, sont encore loin d’atteindre un niveau de maturité suffisant pour garantir une fiabilité sans faille.

L’un des principaux défis est la capacité de l’IA à vérifier les faits. Contrairement aux journalistes humains, ces systèmes ne disposent pas d’un sens critique et se basent uniquement sur les données disponibles, ce qui peut mener à des interprétations erronées.

Les enjeux éthiques

Outre les questions de fiabilité, l’utilisation d’IA pour produire des contenus informatifs soulève des préoccupations éthiques. Comment garantir que les informations générées respectent les principes d’objectivité et d’impartialité ? Et comment s’assurer que ces outils ne nuisent pas au travail des journalistes professionnels ?

Les perspectives d’amélioration

Ce que prépare Apple

Apple semble déterminée à corriger les lacunes de son outil. Parmi les pistes envisagées, l’amélioration des algorithmes de traitement du langage naturel est essentielle. Cela pourrait permettre une analyse plus précise des faits et une meilleure contextualisation des informations.

De plus, l’entreprise pourrait collaborer avec des rédactions afin de garantir que les informations relayées soient exactes et vérifiées.

L’avenir des IA dans les médias

Malgré ses échecs initiaux, Apple Intelligence pourrait préfigurer l’avenir des systèmes d’information automatisée. Si des améliorations techniques et éthiques sont apportées, ces outils pourraient devenir des compléments utiles au journalisme traditionnel, notamment pour la couverture en temps réel d’événements majeurs.

Conclusion

Le retrait temporaire d’Apple Intelligence met en évidence les limites actuelles des systèmes d’IA dans le domaine de l’information. Si l’initiative d’Apple est ambitieuse, elle rappelle également l’importance de la prudence et de la rigueur dans le développement de ces technologies. Alors que l’entreprise travaille à perfectionner son outil, il reste essentiel de surveiller de près l’impact des systèmes d’IA sur la véracité et la qualité de l’information diffusée au grand public.

Share this content:

Laisser un commentaire